Système d'IA

Un système d’IA est un système basé sur une machine conçu pour fonctionner avec différents niveaux d’autonomie et qui peut faire preuve d’adaptabilité après son déploiement et qui, pour des objectifs explicites ou implicites, déduit, à partir des entrées qu’il reçoit, comment générer des résultats tels que sous forme de prédictions, de contenus, de recommandations ou de décisions pouvant influencer les environnements physiques ou virtuels.

Fournisseur

Un fournisseur est une personne physique ou morale, une autorité publique, une agence ou un autre organisme qui développe un système d’IA ou un modèle d’IA à usage général ou qui fait développer un système d’IA ou un modèle d’IA à usage général et les met sur le marché ou met le système en service sous son propre nom ou sa propre marque, que ce soit à titre onéreux ou gratuit.

Déployeur

Un déployeur est toute personne physique ou morale, autorité publique, agence ou autre organisme utilisant un système d’IA sous son autorité, sauf lorsque le système d’IA est utilisé dans le cadre d’une activité personnelle non professionnelle.

Importateur

Un importateur est toute personne physique ou morale située ou établie dans l’Union qui met sur le marché un système d’IA qui porte le nom ou la marque d’une personne physique ou morale établie en dehors de l’Union.

Distributeur

Un distributeur est toute personne physique ou morale intervenant dans la chaîne d’approvisionnement, autre que le fournisseur ou l’importateur, qui met un système d’IA à disposition sur le marché de l’Union.

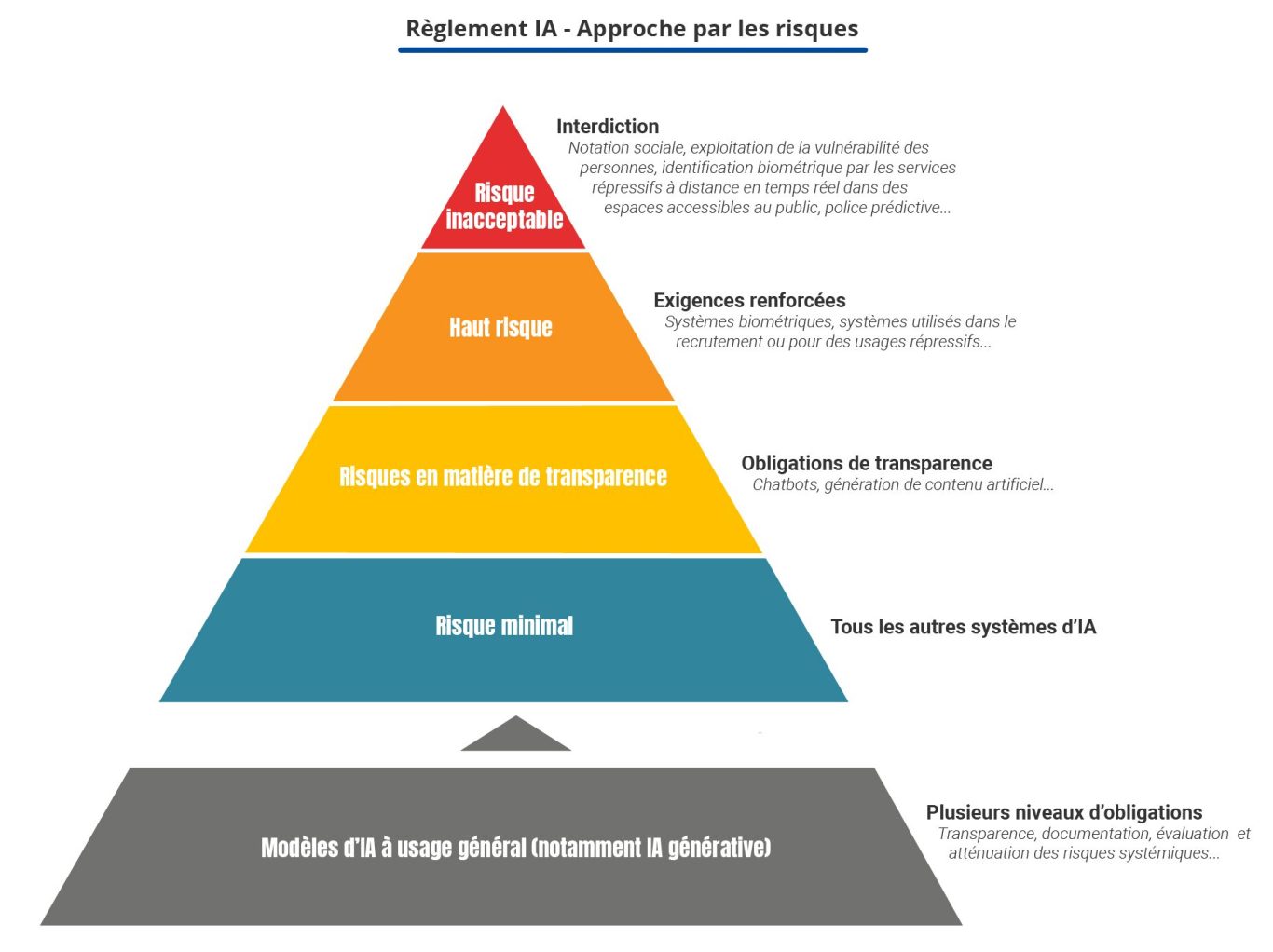

Systèmes d’IA à risque inacceptable

Il s'agit de tout système considéré comme une menace pour les personnes. Ces derniers peuvent comprendre : une manipulation de personnes ou de groupes de personnes spécifiquement vulnérables, à l’instar de jouets activés par la voix, qui peuvent engendrer des comportements dangereux chez les enfants ; la notation sociale (classement des personnes en fonction de leur situation socio-économique, de leur comportement, valeurs, etc.) ; une catégorisation et une identification biométrique des personnes, y compris en temps réel et à distance (par exemple, la reconnaissance faciale). Ces systèmes sont dorénavant proscrits dans l’Union européenne.

Systèmes d’IA à risque élevé

Il s'agit de tout système ou modèle d’IA présentant des risques pour la santé, la sécurité et les droits fondamentaux des personnes. Plus largement, les systèmes constituant des profils et traitant automatiquement des données personnelles pour évaluer la vie d'une personne (performances professionnelles, situation économique, préférences, localisation, etc.) sont considérés à haut risque et sont donc visés par cette classification. Sont concernés, entre autres, les SIA impliqués dans le fonctionnement d’infrastructures critiques où la sécurité des citoyens est en jeu (ex. les transports, l’approvisionnement en eau, en gaz, en électricité, etc.), dans les services privés et publics (ex. évaluation des appels d’urgence, le triage des patients urgents, l’évaluation de la solvabilité, etc.), la formation éducative et professionnelle (affectation aux établissements, évaluation des résultats scolaires, etc.), l’emploi (IA utilisée dans le recrutement ou la sélection de candidats, etc.) ou encore l’application de la loi et des décisions de justice (évaluation du risque de délinquance ou de récidive, profilage, etc.). Des exceptions sont évidemment prévues : recherche d’un disparu, prévention d’une menace terroriste imminente, etc.

Systèmes d’IA à risque limité

Ils recouvrent les systèmes tels que les chatbots, les systèmes de recommandations ou les « deepfakes », doivent être transparents et fournir à leurs utilisateurs des informations sur le contenu généré par IA avec lequel ils interagissent, de même pour des textes générés par IA délivrant une information d’intérêt public.

Systèmes d’IA à risque minimal

Ils recouvrent les systèmes tels que les filtres anti-spam, ou les intelligences artificielles dans les jeux vidéo, ne présentent pas d’obligations spécifiques mais les fournisseurs sont fortement encouragés à présenter des codes de conduite.

Nous avons besoin de votre consentement pour charger les traductions

Nous utilisons un service tiers pour traduire le contenu du site web qui peut collecter des données sur votre activité. Veuillez consulter les détails dans la politique de confidentialité et accepter le service pour voir les traductions.